ディープフェイクとは?危険な悪用リスクと見分け方・対策を解説

- INDEX

-

ディープフェイクとは、AI(人工知能)技術を用いて作られた、本物と見分けが困難な偽の動画や画像、音声のことです。

近年、この技術が悪用されるケースが増加しており、個人・企業ともに深刻なリスクに直面しています。

この記事では、ディープフェイクの仕組みから危険な悪用リスク、具体的な見分け方、そして身を守るための対策までを総合的に解説します。

ディープフェイクとは?AIが生成する本物そっくりの偽コンテンツ

ディープフェイクとは、「ディープラーニング(深層学習)」と「フェイク(偽物)」を組み合わせた造語です。

生成AIなどの技術を活用し、特定の人物の顔や声を別の人物と入れ替えたり、実際には話していない内容を話しているかのように見せかけたりする偽のコンテンツを指します。

この技術について理解を深めることは、巧妙化するデジタル社会の脅威から身を守る第一歩となります。

ディープラーニングを活用した偽動画・音声の生成技術

ディープフェイクの生成には、主にGAN(敵対的生成ネットワーク)と呼ばれるAI技術が用いられます。

この仕組みは、「生成役」と「識別役」の二つのAIを競わせることで成り立っています。

「生成役」のAIが偽のコンテンツを作り、「識別役」のAIがそれを見破るというプロセスを繰り返すことで、偽コンテンツの精度が飛躍的に向上し、人間では見分けがつかないほど自然な動画や音声が生成されます。

顔の入れ替えから音声合成までディープフェイクの主な種類

ディープフェイクにはいくつかの種類が存在し、それぞれ特徴が異なります。

最も代表的なのが「フェイススワップ」で、動画内の人物の顔を別人の顔に違和感なく入れ替える技術です。

次に、既存の映像に合わせて口の動きを別の音声に同期させる「リップシンク」があります。

さらに、少量の音声データから本人の声質を再現し、任意のテキストを読み上げさせる「ボイスクローン(音声合成)」も詐欺などに悪用される危険な種類です。

ディープフェイクがもたらす深刻な危険性と社会的な悪用リスク

ディープフェイク技術の進化は、社会に多くの深刻な問題をもたらしています。

個人や有名人になりすました詐欺、選挙を妨害する偽情報の拡散、名誉毀損やプライバシー侵害など、その影響は広範囲に及びます。

また、企業においても、経営者になりすましたサイバー攻撃による金銭的被害や、ブランドイメージの毀損といったリスクが高まっており、社会全体で対策が急務となっています。

有名人や知人になりすます投資・送金詐欺

ディープフェイク技術は、有名人や企業の経営者、さらには家族や知人になりすました詐欺に悪用されるケースが世界中で報告されています。

犯人は、偽の動画や音声を使ってターゲットを信用させ、投資話を持ちかけたり、偽の指示を出して不正な送金をさせたりします。

特に、SNS広告などで著名人が特定の株や投資商品を推奨するような偽動画は、多くの人が騙される入り口となっています。

世論を不正に操作するフェイクニュースの拡散

ディープフェイクは、政治的な目的でフェイクニュースを拡散し、世論を不正に操作する強力なツールとなり得ます。

例えば、影響力のある政治家が実際には言っていない過激な発言をする偽動画を作成し、選挙期間中にSNSで拡散させると、有権者の投票行動に大きな影響を与える可能性があります。

このような偽情報は、社会の分断を煽り、民主主義の根幹を揺るがしかねない深刻な脅威です。

個人の名誉を著しく傷つけるプライバシー侵害

ディープフェイクの悪用で特に深刻なのが、個人の名誉毀損やプライバシー侵害です。

有名人や一般人の顔を、本人の同意なくわいせつな動画と合成する「ディープフェイクポルノ」は、被害者に深刻な精神的苦痛を与えます。

このような偽コンテンツは、一度インターネット上に拡散されると完全に削除することが困難であり、被害者の社会的評価を著しく傷つける結果を招きます。

企業の信頼を失墜させるブランドイメージの毀損

ディープフェイクは、企業のブランドイメージを意図的に傷つける目的で使われることもあります。

例えば、企業の代表者が不適切な発言をしているかのような偽動画が作成・拡散されれば、株価の下落や顧客離れにつながる恐れがあります。

一度失墜した信頼を取り戻すのは容易ではなく、企業は深刻な経済的・社会的な打撃を受けることになります。

国内外で実際に発生したディープフェイクの悪用事例

ディープフェイク技術は、すでに国内外で深刻な被害をもたらす悪用事例として報告されています。

企業の経営幹部になりすまして従業員を騙し、多額の資金を送金させる詐欺事件や、選挙の公正性を脅かす政治家の偽動画の拡散などが現実に起きています。

これらの事例は、ディープフェイクが単なる技術的な興味の対象ではなく、現実社会に具体的な脅威を与えていることを示しています。

経営幹部の偽音声による巨額の送金詐欺事件

2024年には、香港のある企業で、ディープフェイク技術を悪用した大規模な詐欺事件が発生しました。

犯人は、企業の最高財務責任者(CFO)や他の従業員になりすました偽の映像をビデオ会議で使用し、財務担当者を騙して約2億香港ドル(約38億円)を不正に送金させました。

この事件は、声だけでなく映像も精巧に偽装されており、企業の本人確認プロセスの脆弱性を突いた手口として大きな衝撃を与えました。

政治家の偽動画を利用した選挙への介入

ディープフェイクは、政治的なプロパガンダや選挙妨害にも利用されています。

過去には、海外の選挙で対立候補をおとしめるための偽動画が作成されたり、災害時に政府関係者が偽の情報を発信しているかのような動画が拡散されたりする事例がありました。

このような偽動画は、有権者の判断を誤らせ、選挙結果や社会の安定に深刻な影響を及ぼす可能性があります。

SNSで拡散された一般人のなりすまし被害

ディープフェイクの脅威は、有名人や企業だけに向けられたものではありません。

SNSの普及により、一般人でも顔写真などの個人情報が容易に入手可能になったため、なりすまし被害に遭うリスクが高まっています。

例えば、SNSに投稿した写真が無断で悪用され、わいせつな動画と合成されたり、詐欺アカウントのプロフィール画像に使われたりするケースが報告されており、誰もが被害者になる可能性があります。

騙されないために!ディープフェイクを見分ける5つのチェックポイント

ディープフェイクの技術は日々巧妙化していますが、偽物であることを示す不自然な点を見つけることは可能です。

動画や音声に違和感がないか注意深く確認することで、騙されるリスクを減らせます。

ここでは、ディープフェイクを判別するために注目すべき5つのチェックポイントを紹介します。

これらの点を意識してコンテンツを確認する習慣をつけることが重要です。

不自然な瞬きや表情の動きに注目する

ディープフェイク動画では、人物の表情、特に目の動きに不自然さが現れることがあります。

瞬きの回数が異常に少ない、または多すぎる、あるいは全くしない場合は注意が必要です。

また、顔の動きに対して表情が乏しい、笑顔がひきつっているなど、感情と表情が一致していないように見える場合も、AIによる不自然な編集を疑うべきサインです。

口の動きと音声が微妙にずれていないか確認する

音声と口の動き(リップシンク)の同期は、ディープフェイク生成において技術的に難しい部分です。

話している内容と口の形が合っていない、発音に対して唇の動きが不自然である、といったズレが見られる場合は注意が必要です。

また、口の中の歯の形や並びが不鮮明であったり、不自然に見えたりする場合も、偽造された映像である可能性を示唆しています。

映像の細部(輪郭や影)に不自然な点がないか探す

映像の細部に注目すると、ディープフェイクの痕跡が見つかることがあります。

特に、顔の輪郭部分に不自然な揺らぎやぼやけ、背景との境界線に違和感がないかを確認します。

また、人物の動きに対して光の当たり方や影のつき方が不自然である場合も、後から顔などを合成した可能性が考えられます。

細部への注意深い観察が偽物を見破る鍵となります。

肌の質感や髪の毛の描写がのっぺりしていないか見る

現在のディープフェイク技術では、人間の肌の質感や髪の毛一本一本といった細かな部分を完全に再現するのは難しい場合があります。

映像の中の人物の肌が、しわや毛穴がなく、のっぺりとしたマネキンのように見える場合や、髪の毛の生え際や細かい毛の動きが不自然に見える場合は、ディープフェイクの可能性があります。

リアルな人間らしさが欠けている点に注目してください。

映像全体で画質にムラがないかチェックする

ディープフェイク動画は、多くの場合、特定の人物の顔部分だけを合成しています。

そのため、顔の部分だけが他の部分に比べて妙に鮮明であったり、逆に画質が荒かったりと、映像全体で品質にムラが生じることがあります。

動画全体を見渡し、一部分だけ解像度が異なるなどの違和感がないかを確認することは、ディープフェイクを見分ける有効な手段の一つです。

個人と企業ができるディープフェイクへの具体的な対策方法

ディープフェイクの脅威から身を守るためには、個人と企業がそれぞれの立場で具体的な対策を講じることが不可欠です。

情報を鵜呑みにせず真偽を確認する基本的な姿勢から、組織的なセキュリティ教育、そして最新技術の活用まで、多層的なアプローチで偽情報やなりすましを防ぐ必要があります。

【個人向け】不審な情報源を鵜呑みにせず真偽を確かめる習慣をつける

個人ができる最も基本的な対策は、インターネット上の情報を安易に信用しないことです。

特に、SNSなどで拡散される衝撃的な動画や、有名人をかたった投資話などは、一度立ち止まって疑う姿勢が重要です。

情報の発信元が信頼できる公的機関や大手メディアであるかを確認し、複数の情報源を比較検討することで、偽情報に騙されるリスクを大幅に減らすことができます。

【企業向け】従業員のセキュリティ意識を高める教育を実施する

企業にとって、従業員一人ひとりのセキュリティ意識の向上は不可欠な対策です。

ディープフェイクを用いたビジネスメール詐欺やCEO詐欺の手口について、具体的な事例を交えた研修を定期的に実施することが有効です。

不審な送金指示や情報提供の依頼があった場合に、正規のルートで再確認するなどのルールを徹底することで、組織全体としての防御力を高めます。

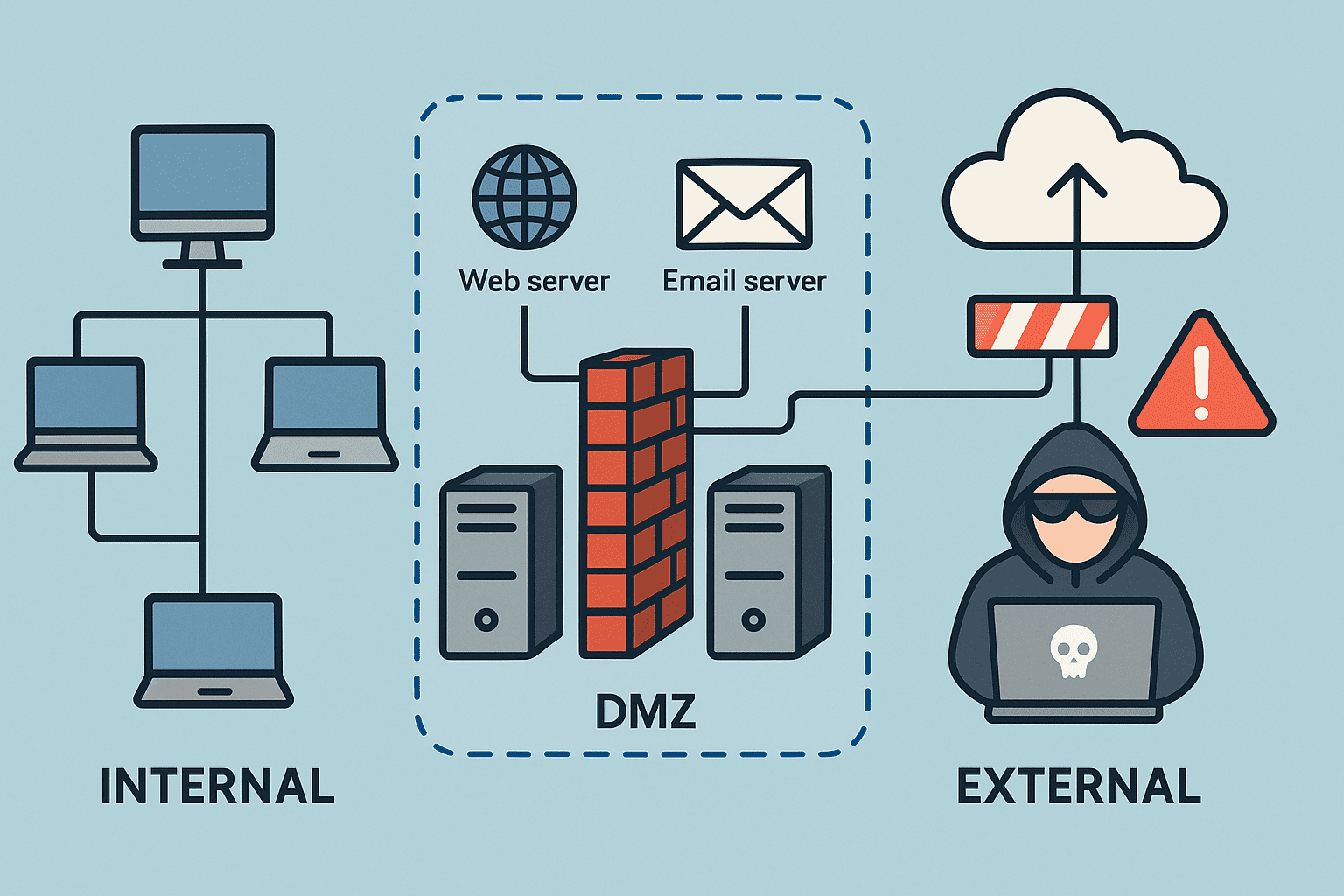

【企業向け】オンラインでの本人確認プロセスを強化する

ディープフェイクによるなりすましを防ぐため、企業はオンライン上での本人確認プロセスを強化する必要があります。

従来のIDとパスワードによる認証に加え、顔認証や指紋認証などの生体認証を組み合わせた多要素認証の導入が効果的です。

特に、金銭の移動や重要情報へのアクセスが伴う操作では、複数の手段で本人確認を行うことで、不正アクセスのリスクを低減させます。

【共通】ディープフェイクを検出するツールの活用を検討する

技術の進化に伴い、ディープフェイクを自動で検出するツールやサービスの開発も進んでいます。

これらの検出ツールは、AIを用いて映像の不自然な点やデジタル的な痕跡を分析し、コンテンツが偽造されたものである可能性を判定します。

個人での利用はまだ限定的ですが、企業ではメディアコンテンツの真贋判定や、オンラインでの本人確認プロセスの補助として、このような専門ツールの導入を検討することが有効な対策となります。

もし被害に遭ったら?ディープフェイクコンテンツへの対処法

万が一、自身がディープフェイクの被害に遭ってしまった場合、迅速かつ冷静な対応が求められます。

被害の拡大を防ぎ、自身の権利を守るためには、コンテンツが公開されているプラットフォームへの削除申請、Google検索からの除外リクエスト、そして警察や法的な専門家への相談という手順を速やかに実行することが重要です。

コンテンツが投稿されたプラットフォームへ削除を申請する

自身のなりすましや名誉を毀損するディープフェイクコンテンツを発見した場合、最初に行うべきは、そのコンテンツが投稿されているSNSや動画共有サイトなどのプラットフォーム運営者に対して、利用規約違反を根拠に削除を申請することです。

多くのプラットフォームでは、なりすましや嫌がらせに関するポリシーを設けており、専用の報告フォームから通報が可能です。

Google検索結果からの削除をリクエストする

プラットフォームからコンテンツが削除されても、Googleなどの検索結果にキャッシュやリンクが残ってしまう場合があります。

Googleは、同意のない性的な偽画像(ディープフェイクポルノなど)について、本人からのリクエストに基づき検索結果から削除するポリシーを設けています。

専用のヘルプページから必要な情報を提出し、検索結果からの削除を要請することが可能です。

警察や法的な専門機関へ相談する

ディープフェイクによる被害は、名誉毀損罪や著作権法違反などの犯罪に該当する可能性があります。

被害が悪質な場合や、金銭的な被害が発生した場合は、証拠を保全した上で速やかに最寄りの警察署やサイバー犯罪相談窓口に相談してください。

また、削除請求や損害賠償請求などを検討する場合は、インターネット問題に詳しい弁護士などの法的な専門機関へ相談することが解決への近道となります。

ディープフェイクに関するよくある質問

ディープフェイク技術に関する疑問は多岐にわたります。

ここでは、その作成の容易さ、法的な罰則の有無、そして技術の有益な活用法といった、多くの人が抱くであろう質問について、簡潔に回答します。

Q. ディープフェイク動画は個人でも簡単につくれますか?

はい、作れます。

スマートフォンのアプリやオンラインサービスを利用することで、専門知識がない個人でも比較的簡単にディープフェイク動画や画像を作成できるようになりました。

これらのツールは、数枚の顔写真や短い動画を元に、顔を入れ替えるなどの加工を手軽に行えるため、技術的なハードルは大幅に下がっています。

Q. ディープフェイクを作成したり拡散したりすると法律で罰せられますか?

はい、内容や目的によっては法律で罰せられます。

日本には「ディープフェイク罪」という直接的な法律はありませんが、他人の名誉を傷つければ名誉毀損罪、わいせつな内容であればわいせつ物頒布等罪、著作物を無断で使えば著作権法違反に問われる可能性があります。

政府も法整備の検討を進めており、安易な作成や拡散は大きな法的リスクを伴います。

Q. ディープフェイク技術には良い活用法もありますか?

はい、あります。

エンターテインメント分野では、映画制作で俳優を若返らせたり、故人をCGで再現したりする際に活用されています。

また、広告マーケティングで多言語対応のコンテンツを効率的に作成したり、教育分野で歴史上の人物が語りかける教材を作ったりするなど、社会に有益な活用法も期待されています。

まとめ

ディープフェイク技術の進化は、私たちの想像を超えるスピードで社会に浸透しており、その脅威はもはや対岸の火事ではありません。AIが生成する精巧な偽コンテンツは、個人のプライバシーを侵害するだけでなく、企業の経済的損失やブランド価値の失墜を招く重大なリスクとなっています。こうした巧妙ななりすましや詐欺から組織を守るためには、個人の注意喚起にとどまらず、IT資産管理とセキュリティ対策を統合的に行う仕組みの導入が極めて重要です。

こうした課題に対応できるツールのひとつが、「ヒト」を軸とした情報セキュリティ対策「AssetView Cloud +」です。PCの操作ログ管理やデバイス制御、不審な挙動の検知など、企業のセキュリティ基盤を強固にする多彩な機能を備えています。ディープフェイクを悪用したフィッシング詐欺や、マルウェア感染を狙った不審なファイル操作が発生した際も、詳細なログ管理によって迅速な状況把握と原因究明が可能となります。

加えて、昨今急速に普及する生成AIの利用においても、AssetView Cloud +は強力なガバナンス基盤を提供します。ChatGPTへの送信ログを取得・可視化する機能により、「いつ・誰が・何を送信したのか」を把握することができ、業務上のセンシティブ情報や機密情報の誤送信を早期に確認できます。これにより、情報漏洩リスクの抑止と、社内における生成AI利用の透明性向上を同時に実現します。

デジタル化が加速する現代において、偽情報を見極める目を持つとともに、システム面での防御を固めることは企業存続の鍵となります。エンドポイントの監視から生成AIのガバナンスまでをワンプラットフォームで管理できるAssetView Cloud +を活用し、多層的な防御態勢を整えることで、未知の脅威にも対抗できる安全なビジネス環境を構築しましょう。